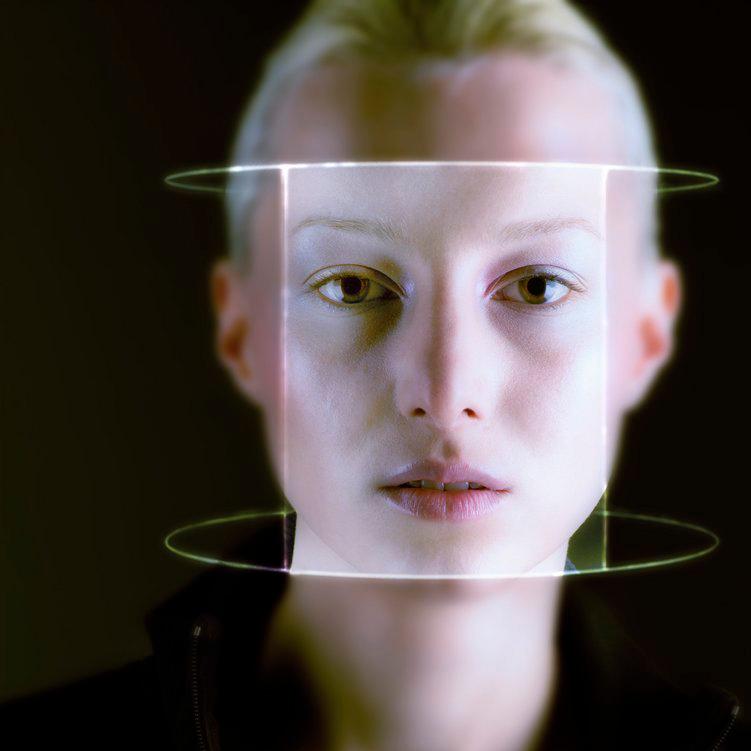

"Deepfaker" og kildekritikk av videomateriale

Fagstoff

Fagartikkel

Nyhetsredaksjoner og -byråer er årvåkne for intelligent videoprogramvare som manipulerer ansikt og tale. Kildekritikk av videoopptak er noe av løsningen.

Åpne i fag:

- Medie- og informasjonskunnskap 1

- Medieuttrykk 1

- Mediesamfunnet 2

- Medie- og informasjonskunnskap 2

- Produksjon og historiefortelling (IM-IKM vg1)

- Medieuttrykk 2

- Mediesamfunnet 2

- Konseptutvikling og kommunikasjon (IM-MED vg2) - Ressurssamling

- Mediesamfunnet 3

- Medieuttrykk 3

- Mediesamfunnet 1

- Verktøykassa – for elever

- Medie- og informasjonskunnskap 1

- Verktøykassa – for lærere